Onderzoekers in informatica en psychologie hebben een studie gepubliceerd rond de ethiek van de autonome auto’s en de reactie die geprogrammeerd moet worden wanneer een dodelijke aanrijding niet meer te voorkomen is en waarbij de auto zelf moet beslissen wie hij doodt. Dit morele vraagstuk is uiteraard delicaat en verschrikkelijk complex om om te zetten in informaticagegevens. Jean-François Bonnefon van de universiteit van Toulouse, Azim Shariff van de universiteit van Oregon en Iyad Rahwan van het Massachussetts Institute of Technology hebben rond dit dilemma gewerkt.

Typisch geval

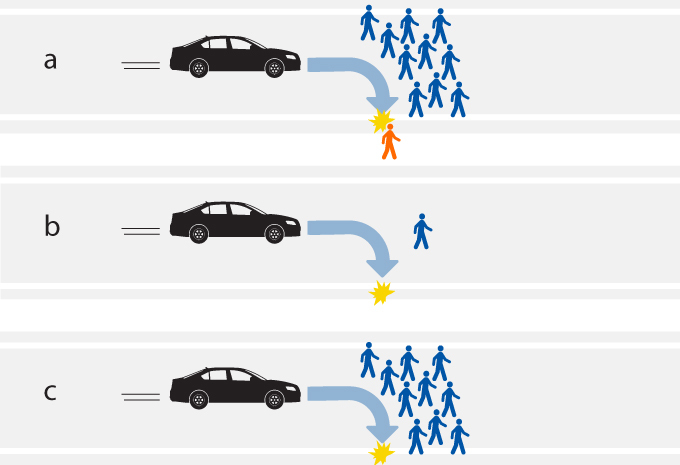

Om de extreme keuze om een mens op te offeren te kunnen begrijpen, werd een voorbeeld ontwikkeld. Een groep van meerdere personen steekt de weg onverwacht over. De zelfrijdende auto heeft geen tijd meer om te remmen en om een tragedie te voorkomen kan hij enkel van de rijweg afrijden (c), met het risico één voetganger op het voetpad te doden (a). Deze oplossing, de rijweg verlaten, zou ook gekozen worden indien maar één voetganger zou oversteken (b). In eerste instantie zal het voertuig altijd de bestuurder en de inzittenden van het voertuig opofferen. Het probleem wordt nog ingewikkelder wanneer de groep op de weg bestaat uit volwassenen en er op het voetpad een kind loopt. Een mens zal doorgaans geneigd zijn om het leven van een kind te sparen, maar een computer denkt niet noodzakelijk zo …

Complexe situaties

De drie onderzoekers geven aan dat het ethisch aanvaardbaar is om een autonome auto tegen een muur te sturen om een motorrijder te ontwijken, aangezien de overlevingskans van de passagiers van de auto groter is dan die van de motorrijder. Maar welke optie kiezen als er ook kinderen in de auto zitten? Moeten de bestuurder en zijn passagiers altijd opgeofferd worden? De constructeurs zouden verschillende ‘morele’ algoritmen kunnen gebruiken of de bestuurder laten kiezen tussen een scenario met hoge morele waarde of een scenario waarin hij zijn eigen overleving vooropstelt. Maar wie krijgt dan de blaam na een tragisch ongeval? De bestuurder die de bescherming van zijn eigen leven als prioriteit programmeerde? Of de constructeur die een dergelijke optie heeft aangeboden in de ethische code van zijn auto? Er zijn duidelijk nog heel veel vragen en volgens de auteurs wordt het hoog tijd om daarop een antwoord te geven vooraleer de autonome auto’s losgelaten worden op onze wegen.

Mens versus machine

De recente filmpjes over het soms vreemde gedrag van de Tesla in semi-autonome modus leggen zowel de beperkingen van het systeem bloot als de neiging van de mens om het te testen tot in het onredelijke. Sommige bestuurders hebben de neiging om de risico’s te onderschatten en zichzelf en de andere weggebruikers die ze tegenkomen, in gevaar te brengen. En dan hebben we het nog niet over de problemen met vermoeidheid, agressiviteit, drugs en alcohol. Allemaal afwijkingen die een machine niet heeft. In een gecoördineerd en klassiek verkeer is een machine dan ook altijd veiliger. Maar ongewone situaties zou een zelfrijdende auto verkeerd kunnen interpreteren: zijn gebrek aan inventiviteit en improvisatie zou dan kunnen leiden tot ongewenste reacties. Temeer daar de auto één groot gebrek heeft: hij is niet bang van de dood …